Azure AI Serviecsのエンドポイントについて

Azure AI Servicesは、登場当初は様々なURL(エンドポイント)で提供されていました。現在は、Azure AI Servicesの統一したURLで提供されています。

エンドポイントの例外

ただし、Speech ServiceとTranslatorの2つについては、統一したURLではなく登場したときのURLでのアクセスとなります。

ただし、その場合でも、キーについては統一したキーで利用可能です。

1例としてSpeech Serviceについて、実際にAzure ポータルでリソースを作成して比較してみましょう。

Speechリソースとして作成した場合

Speechリソースを指定

Azure ポータルにサインインしたら、

- サイドメニューの[リソースの作成]をクリック

- [Azureサービスのみ]チェックとして[Marketplaceを検索]欄で「音声」と入力して検索

- [音声]リソースの[作成]をクリック

するとSpeechリソースとして音声認識/音声合成などが可能なSpeech ServiceというAIが使えるようになります。

Speech Serviceリソースを設定

Speech Serviceリソースを作成するために必要な設定を行うときに重要なのは次の点です。

- リージョン:利用する地域を選択(レイテンシーが早く、域内にすることでデータ保護関連に抵触しないため)

- 名前:自リソース内での識別子となるのでわかりやすい名前を指定

- 価格レベル:Freeであれば時間制限ありだが無料利用も可能

Speech Serviceリソースのエンドポイント

作成したSpeech Serviceリソースへアクセスするためのエンドポイントは次のようになります。

https://japanwest.api.cognitive.microsoft.com/

リソース作成時に指定した名前などは含まれず、リージョンとキー値で利用するリソースが特定されます。

Speech ServiceとTranslator以外のAIサービスのエンドポイントは、リソースエンドポイントと同一となります。

Speech Serviceのサービスエンドポイント

Speechリソースのリージョンとして「japanwest」を指定した場合、

音声からテキストにする(いわゆる文字起こし)するSpeech to Text APIのエンドポイントは次のようになります。

https://japanwest.stt.speech.microsoft.com

同様にテキストから音声にする(いわゆる音声合成)するText to Speechのエンドポイントは次のようになります。

https://japanwest.tts.speech.microsoft.com

なお、このエンドポイントにアクセスするときのキー値は、Azure AI Servicesのキー値となります。

Azure AI Serivicesリソースとして作成した場合

Azure ポータルにサインインしたら、

- サイドメニューの[リソースの作成]をクリック

- [Azureサービスのみ]チェックとして[Marketplaceを検索]欄で「Azure AI サービス」と入力して検索

- [Azure AI サービス]リソースの[作成]をクリック

するとAzure AI Serivcesリソースとして、そこに含まれるAIに対して単一エンドポイントでアクセス可能なリソースが作成できます。

Azure AI Serivicesリソースを指定

Azure AI Serivcesリソースを作成するために必要な設定を行うときに重要なのは次の点です。特に名前が重要です。

- リージョン:利用する地域を選択(レイテンシーが早く、域内にすることでデータ保護関連に抵触しないため)

- 名前:グローバルで唯一の名前の指定が必要なので製品名など入れるとよい

- 価格レベル:Standardプランのみ指定可能(Freeがない)

Azure AI Serivicesリソースのエンドポイント

作成した Azure AI Serivicesリソースへアクセスするためのエンドポイントは次のようになります。

https://[名前].cognitiveservices.azure.com/

作成時に指定した名前を含んだ専用のエンドポイントとなります。

ただし、Speech ServiceとTranslatorについては、個々のエンドポイントとなります。

Speech Serviceのサービスエンドポイント

Azure AI Serivicesリソースのリージョンとして「japaneast」を指定した場合、

音声からテキストにする(いわゆる文字起こし)するSpeech to Text APIのエンドポイントは次のようになります()。

https://japaneast.stt.speech.microsoft.com

同様にテキストから音声にする(いわゆる音声合成)するText to Speechのエンドポイントは次のようになります。

https://japaneast.tts.speech.microsoft.com

なお、このエンドポイントにアクセスするときのキー値は、Azure AI Servicesのキー値となります。

Azure AI Foundlyとの関係

AzureのAI関連としては、「Azure AI Services」以外に「Azure AI Foundly」もあります。

この両者の関係は次のような関係です。

「Azure AI Foundly」=「Azure AI Services」+「生成AIモデル」

つまり、Azure AI Foundlyリソースとして、Azure AI Serviceに含まれているAIサービスを使うこともできます。

Azure AI Foundlyリソースとして作成した場合

Azure ポータルにサインインしたら、

- サイドメニューの[リソースの作成]をクリック

- [Azureサービスのみ]チェックとして[Marketplaceを検索]欄で「Azure AI Foundly」と入力して検索

- [Azure AI Foundly]リソースの[作成]をクリック

するとAzure AI Foundlyリソースとして、そこに含まれるAIに対して単一エンドポイントでアクセス可能なリソースが作成できます。

Azure AI Foundlyリソースを指定

Azure AI Foundlyリソースを作成するために必要な設定を行うときに重要なのは次の点です。特に名前が重要です。

- リージョン:利用する地域を選択(レイテンシーが早く、域内にすることでデータ保護関連に抵触しないため)

- 名前:グローバルで唯一の名前の指定が必要なので製品名など入れるとよい

- 価格レベル:Standardプランのみ指定可能(Freeがない)

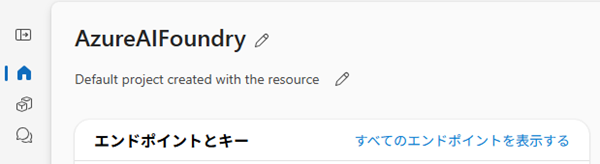

Azure AI Foundlyリソースのエンドポイント

作成した Azure AI Serivicesリソースへアクセスするためのエンドポイントは次のようになります。

https://[名前].services.ai.azure.com/

作成時に指定した名前を含んだ専用のエンドポイントとなります。

ただし、Speech ServiceとTranslatorについては同様に個々のエンドポイントとなります。

Azure AI Foundlyポータル

Azure AI Foundlyリソースにアクセスすると「Azure AI Foundlyポータル」への移動リンクがあります。

すべてのエンドポイントを表示

リンクをクリックしてポータルに移動したら、[すべてのエンドポイントを表示する]リンクをクリックしてみてください。

Speech Serviceのエンドポイントを表示

[サービスエンドポイント]をクリックすると、Azure AI Servicesに含まれるAIサービスが一覧表示されるので「Azure AI 音声」=Speech Serviceをクリックします。

表示された内容から、Speech Serviceのサービスエンドポイントは、他の方法で作成したときと同じことがわかります。

最後に

今回は、Azure AI Servicesに含まれている各AIサービスを使うためのリソース作成方法を3種類紹介しました。

どの方法で作成しても、サービスエンドポイントはほぼ同じであり、そこから先の利用方法は同一となります。

3種類の中でお勧めの方法としては、「Azure AI Foundly」で作る方法となります。この方法の利点は、「プレイグラウンド」がある点です。

このプレイグラウンドを使うことで、ノーコードでAIサービスを試すことが可能です。どのようなAIかを確認できます。

次回以降は、この「プレイグラウンド」も活用し、1つ1つAIサービスを見ていきましょう。生成AIのみで完結するのも1つの方法ですが、Auzre AI Servicesも併用し、より効果的な問題解決ができるかを検討してみる一助になれば幸いです。